1/4 - Waarom AI overtuigend klinkt, ook als het fout zit | Costa Blanca

Vraag AI iets wat je goed kent en je ziet het snel. Het meeste van het antwoord klinkt goed. Maar ergens in die nette zinnen zit iets wat niet klopt. Dit is waarom dat elke keer weer gebeurt.

Waarom AI overtuigend klinkt, ook als het fout zit

Vraag ChatGPT, Claude of Google AI naar iets wat je goed kent. Echt goed kent. Je eigen vak, je eigen land, je eigen markt.

Lees het antwoord goed door.

Het meeste klinkt goed. Een deel klinkt logisch. En ergens tussen die gepolijste zinnen zit iets dat niet klopt. Een feit dat verouderd is. Een regel uit het verkeerde land. Een bewering die aannemelijk klinkt maar niet helemaal waar is.

Het probleem is dat het er precies hetzelfde uitziet als de delen die wél kloppen.

AI denkt niet. Het voorspelt.

Dit is de eenvoudigste manier om te begrijpen wat er echt gebeurt.

Ken je de tekstsuggesties op je telefoon? Je typt "tot ziens om" en hij stelt "6 uur," "half 8" of "het kantoor" voor. Je telefoon denkt niet na over je agenda. Het voorspelt welk woord er normaal gesproken als volgende komt, op basis van alles wat je eerder hebt getypt.

AI werkt op dezelfde manier. Alleen op een schaal die moeilijk voor te stellen is.

Het werd getraind op een enorme hoeveelheid tekst. Websites. Boeken. Artikelen. Forums. Van al die tekst leerde het patronen. Welke ideeën samen neigen te verschijnen. Hoe een antwoord op een vraag er normaal gesproken uitziet. Hoe een zin over loodgietersregelgeving er typisch uitziet, of een pagina over Spaans vastgoedrecht, of een blogpost over marketing voor kleine bedrijven.

Google's eigen introductie tot grote taalmodellen legt het zo uit: een taalmodel berekent de kans op wat er als volgende in een reeks tekst komt. Elk woord in het antwoord is een berekende gok, geen opgezocht feit. Het produceert hoe het antwoord er waarschijnlijk uitziet, op basis van alles wat het heeft gezien.

De meeste keren is dat echt nuttig. Maar nuttig en correct zijn 2 verschillende dingen. En AI kan ze niet altijd van elkaar onderscheiden.

De zelfverzekerde toon is het gevaarlijke deel

Een vriend die iets niet weet aarzelt. Hij zegt "ik denk," of "ik weet het niet zeker, dat zou je even moeten controleren." Je weet dat je het met een korreltje zout moet nemen.

AI produceert dezelfde soepele, stellige toon of het nu helemaal gelijk heeft of volledig fout zit.

Geen aarzeling. Geen zichtbare onzekerheid. Geen "dit kan in Spanje trouwens anders zijn." Gewoon schone, zelfverzekerde zinnen die klinken alsof ze komen van iemand die het weet.

Een ondernemer aan de Costa Blanca vertelde me dat ze ChatGPT had gevraagd naar de wettelijke regels voor het weergeven van prijzen in haar etalage. Het antwoord kwam direct. Gedetailleerd. Zelfverzekerd. Voor zover ze kon beoordelen volledig correct.

Het was gebaseerd op Brits recht.

De AI wist niet waar ze was. Het produceerde gewoon hoe regels voor prijsweergave er normaal gesproken uitzien, en in de trainingsdata die het had gezien, kwamen de meeste van die artikelen uit het Verenigd Koninkrijk. Het klonk zeker omdat het altijd zo klinkt.

Ze had het antwoord bijna uitgeprint en aan haar notaris gegeven.

De informatie heeft een houdbaarheidsdatum

Elk AI-model werd getraind op data tot een bepaald moment in de tijd. Na die datum weet het niet wat er is gebeurd.

Vraag het naar iets recents en het geeft ofwel toe dat het het niet weet, wat eerlijk is, of het vult de leemte met iets wat aannemelijk klinkt, wat het probleem is. Vraag het naar lokale prijzen, lokale regelgeving, of specifieke regels voor bedrijven in Spanje, en de trainingsdata waaruit het put is vaak dun, verouderd, of gebaseerd op andere landen.

Het antwoordt toch. Zelfverzekerd. In volledige zinnen.

Het CSET-onderzoekscentrum aan de Georgetown University beschrijft dit als de kern van hoe taalmodellen werken: ze berekenen welke tekst er waarschijnlijk als volgende komt, op basis van patronen in enorme hoeveelheden data. Het antwoord is altijd een voorspelling, geen geverifieerd feit.

Dat is een fundamenteel iets om te begrijpen voordat je AI vertrouwt met iets wat ertoe doet.

Waarom dit anders is dan een Google-zoekopdracht

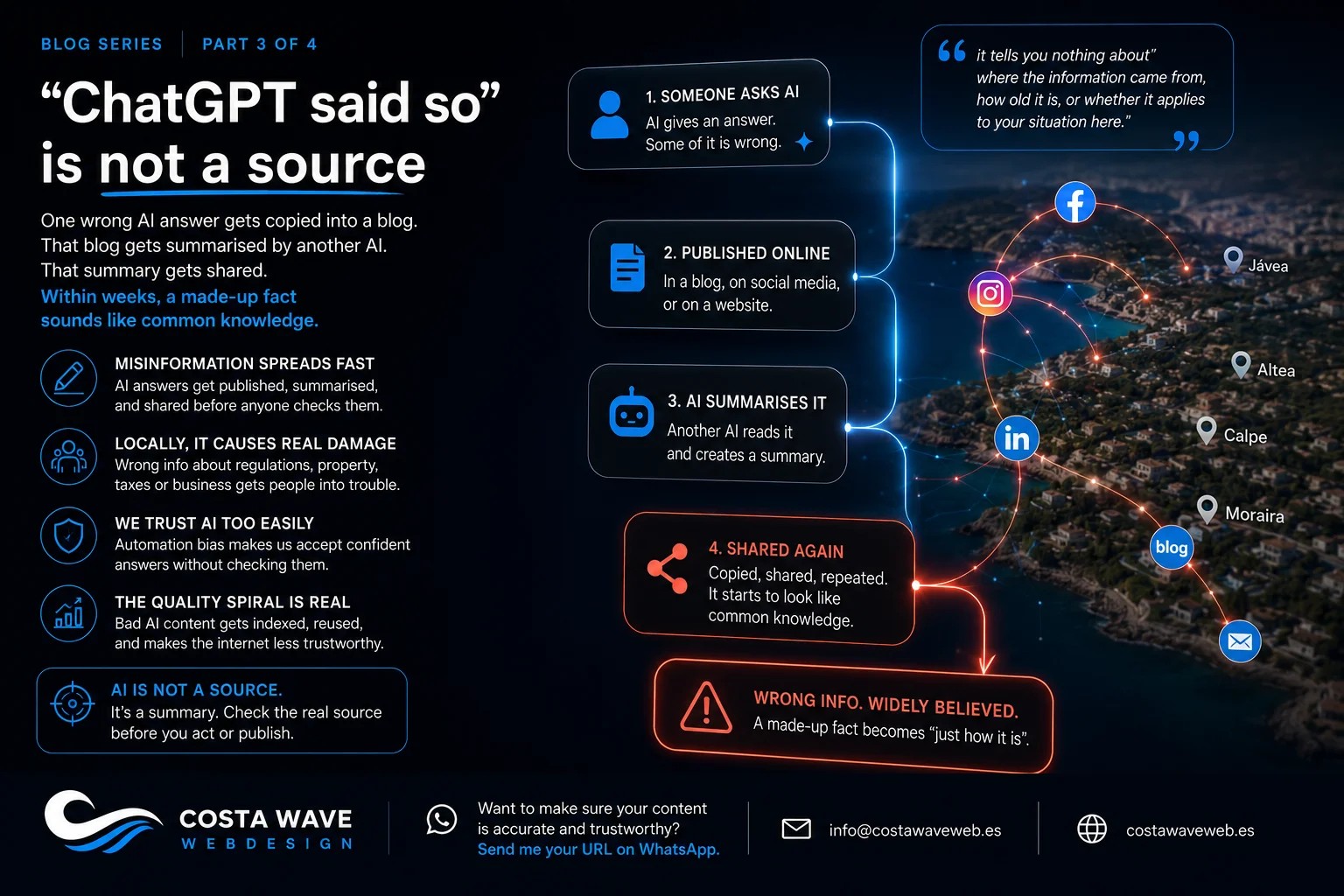

Als je iets googelt, krijg je links naar bronnen. Je kunt zien wie het schreef, wanneer, en waar het vandaan komt. Je kunt beoordelen of de bron betrouwbaar is.

AI geeft je een afgerond antwoord zonder zichtbare bron. Geen datum. Geen land van herkomst. Geen manier om te zien waar de informatie vandaan komt of hoe oud het is.

Het voelt efficiënter. En soms is het dat ook. Maar het verwijdert de stap waarbij je normaal gesproken de bron zou beoordelen, en die stap bestaat om een goede reden.

"AI zei het" is nooit genoeg

Dit is het patroon dat ik het vaakst zie aan de Costa Blanca.

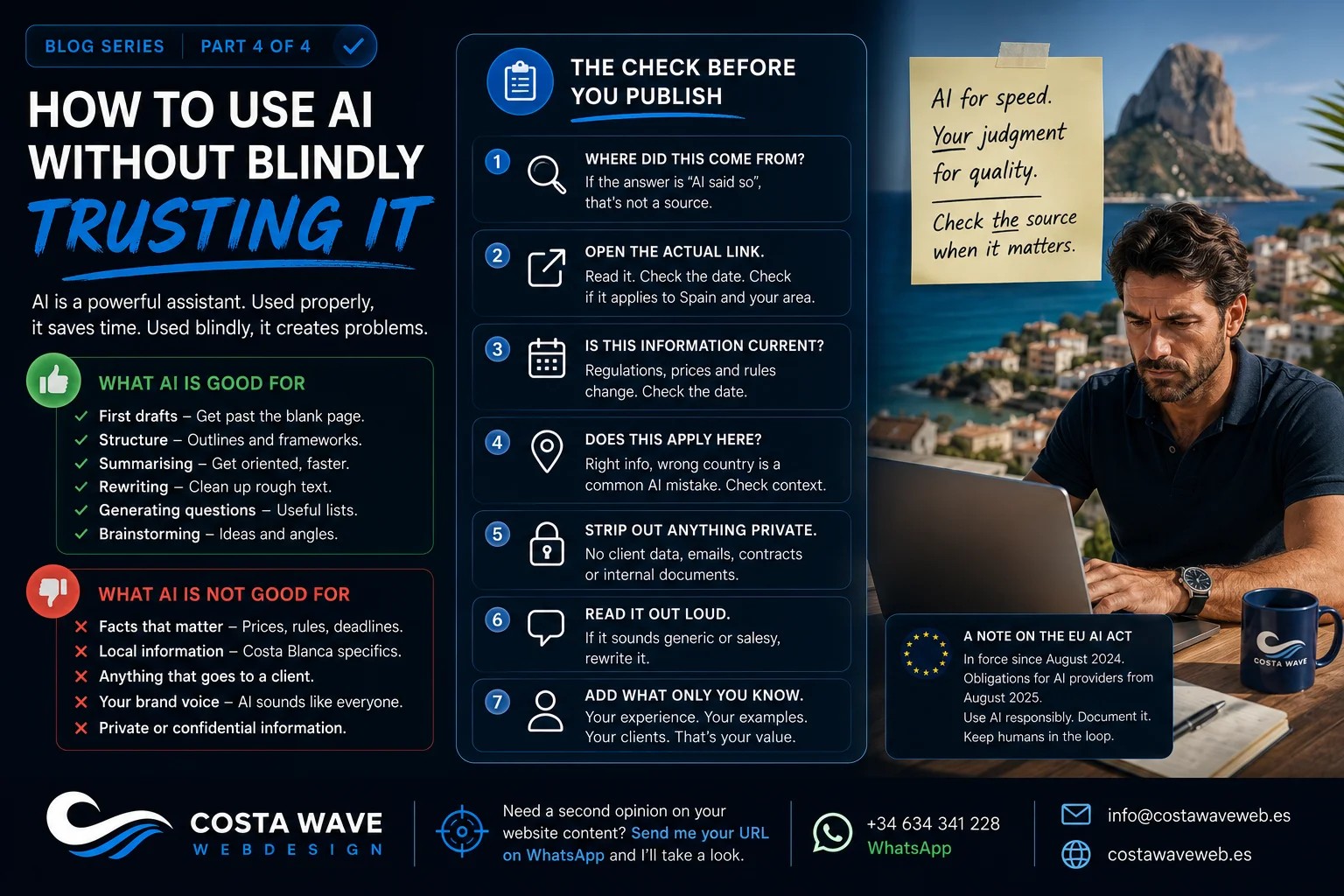

Een ondernemer gebruikt AI om websitecontent te schrijven. Of om advies te krijgen over SEO. Of om een regel te controleren. En ze behandelen de output als klaar. Af. Klaar voor gebruik.

AI kan echt helpen bij al die dingen. Ik gebruik het zelf. Maar de output is een startpunt, geen definitief antwoord.

De feiten moeten nog worden gecontroleerd. De lokale details moeten nog worden toegevoegd. Elke bewering die jouw bedrijf, jouw klanten, of jouw juridische positie raakt heeft een echte bron nodig.

Niet de samenvatting van AI van een bron. De werkelijke bron, geopend, gelezen, en gecontroleerd op datum en land.

Het volgende artikel in deze serie gaat over wat er gebeurt als AI het antwoord niet heeft maar je er toch een geeft. Het heet hallucinatie, en het komt vaker voor dan de meeste mensen beseffen.

Lees deel 2: AI liegt niet. Het vult gaten op.

Als je wilt weten of de content van je website is gebouwd op solide funderingen of op AI-giswerk, stuur me je URL via WhatsApp en ik kijk er naar.

Lees meer:

- Moet je AI gebruiken voor je websiteteksten?

- Waarom een AI-website geen klanten oplevert

- Wat is GEO? Waarom je Costa Blanca-bedrijf het moet kennen

- Lokale SEO voor de Costa Blanca: wat echt werkt in 2026

Blijf op de hoogte

Meld je aan en ontvang een berichtje als er een nieuw artikel online staat.